使用wxPython和OpenCV实现手势识别相机功能

目录

- 引言

- 项目概述

- 功能

- 技术栈

- 依赖安装

- 实现原理

- 手势检测逻辑

- 拍照控制

- 代码分析

- 主窗口类 (MainFrame)

- 摄像头面板类 (CameraPanel)

- 初始化

- 手势检测 (detect_gestures)

- 拍照逻辑 (on_timer)

- 使用说明

- 优化建议

- 运行结果

- 总结

引言

在这篇博客中,我将分享一个有趣的 python 项目:通过 wxPython 创建图形界面,利用 OpenCV 的计算机视觉技术实现实时手势识别,当检测到&ld编程客栈quo;V”字(胜利)手势时自动连拍 9 张照片,而检测到拳头手势时立即停止拍照。这个程序结合了摄像头输入、手势检测和文件保存功能,适合作为学习计算机视觉和 GUI 开发的入门项目。

以下是项目的完整实现过程,包括代码分析、使用说明和可能的优化建议。项目概述

功能

- 实时视频捕获:通过摄像头捕获视频流并显示在 wxPython 界面上。

- 手势识别:

- Victory 手势:检测到“V”字手势时,触发连拍 9 张照片。

- 拳头手势:检测到拳头时,立即停止正在进行的拍照。

- 照片保存:照片以时间戳命名,保存到指定文件夹(

victory_photos)。 - 冷却时间:拍照完成后有 5 秒冷却时间,避免重复触发。

- 界面反馈:实时显示摄像头画面、手势检测状态、手指数量和轮廓密实度。

技术栈

- wxPython:用于创建图形用户界面(GUI)。

- OpenCV:用于摄像头视频处理和手势检测。

- NumPy:用于图像数组操作。

- Python 标准库:用于文件管理和时间戳生成。

依赖安装

运行程序前,请确保安装以下依赖:

pip install wxPython opencv-python numpy

实现原理

手势检测逻辑

手势识别基于 OpenjsCV 的肤色检测和轮廓分析,主要步骤如下:

肤色检测:

- 将图像从 BGR 转换为 HSV 颜色空间。

- 使用预定义的肤色范围(

lower_skin和upper_skin)生成二值掩码。 - 通过形态学操作(膨胀和高斯模糊)优化掩码,去除噪声。

轮廓检测:

- 使用

cv2.findContours找到掩码中的轮廓。 - 选择面积最大的轮廓,假设其为手部。

- 使用

凸包与缺陷分析:

- 计算轮廓的凸包(

cv2.convexHull),用于检测手指间的凹陷。 - 使用

cv2.convexityDefects找到凸缺陷,计算手指数量。 - 通过角度过滤(小于 90 度)判断缺陷是否为手指间隙。

- 计算轮廓的凸包(

手势判定:

- Victory 手势:检测到 2 个手指。

- 拳头手势:轮廓密实度(

solidity = contour_area / hull_area)大于 0.8 且手指数量少于等于 1。

可视化:

- 在界面上绘制手部轮廓(绿色)、凸缺陷点(红色圆点)。

- 显示手指数量、密实度和手势类型。

拍照控制

- 触发拍照:当检测到 Victory 手势且不在冷却时间内,开始连拍。

- 停止拍照:检测到拳头手势时立即中断。

- 保存照片:每张照片以时间戳和序号命名,保存到

victory_photos文件夹。

代码分析

以下是代码的关键部分分析:

主窗口类 (MainFrame)

class MainFrame(wx.Frame):

def __init__(self):

super(MainFrame, self).__init__(None, title="使用wxPython和OpenCV实现手势识别相机功能", size=(800, 600))

self.camera_panel = CameraPanel(self)

sizer = wx.BoxSizer(wx.VERTICAL)

sizer.Add(self.camera_panel, 1, wx.EXPAND)

self.SetSizer(sizer)

- 创建一个 800x600 的窗口,包含菜单栏和状态栏。

- 将

CameraPanel添加到布局中,负责摄像头显示和手势检测。

摄像头面板类yiVNqk (CameraPanel)

初始化

class CameraPanel(wx.Panel):

def __init__(self, parent):

super(CameraPanel, self).__init__(parent)

self.capture = cv2.VideoCapture(0)

self.timer = wx.Timer(self)

self.Bind(wx.EVT_TIMER, self.on_timer, self.timer)

self.timer.Start(100) # 10 FPS

- 初始化摄像头并设置分辨率为 640x480。

- 使用定时器每 100ms 更新一次画面(10 FPS)。

手势检测 (detect_gestures)

def detect_gestures(self, frame, display_frame):

hsv = cv2.cvtColor(frame, cv2.COLOR_BGR2HSV)

mask = cv2.inRange(hsv, self.lower_skin, self.upper_skin)

contours, _ =编程 cv2.findContours(mask, cv2.RETR_TREE, cv2.CHAIN_APPROX_SIMPLE)

if len(contours) > 0:

max_contour = max(contours, key=cv2.contourArea)

if cv2.contourArea(max_contour) > 5000:

hull = cv2.convexHull(max_contour, returnPoints=False)

defects = cv2.convexityDefects(max_contour, hull)

finger_count = 0

# 计算手指数量和密实度

solidity = float(contour_area) / hull_area if hull_area > 0 else 0

is_victory = (finger_count == 2)

is_fist = (solidity > 0.8 and finger_count <= 1)

return is_victory, is_fist, display_frame

- 实现肤色检测、轮廓分析和手势判定。

- 返回 Victory 和拳头手势android的布尔值,以及带可视化标记的帧。

拍照逻辑 (on_timer)

def on_timer(self, event):

ret, frame = self.capture.read()

is_victory, is_fist, display_frame = self.detect_gestures(frame, frame.copy())

if not self.taking_photos and is_victory and time.time() - self.last_detection_time > self.cooldown_period:

self.taking_photos = True

self.photo_count = 0

if self.taking_photos and is_fist:

self.taking_photos = False

if self.taking_photos:

self.take_photo(frame)

self.photo_count += 1

if self.photo_count >= 9:

self.taking_photos = False

- 每帧检测手势,根据状态触发或停止拍照。

- 使用

self.photo_count控制连拍 9 张。

使用说明

运行程序:

- 确保摄像头可用并安装依赖。

- 执行脚本,界面会显示摄像头画面。

手势交互:

- Victory 手势:伸出食指和中指,触发连拍。

- 拳头手势:握拳,停止拍照。

查看照片:

- 照片保存到当前目录下的

victory_photos文件夹。 - 文件名格式:

victory_YYYYMMDD_HHMMSS_X.jpg(X 为序号)。

- 照片保存到当前目录下的

优化建议

光照适应性:

- 当前肤色范围固定,可根据环境动态调整

lower_skin和upper_skin。

- 当前肤色范围固定,可根据环境动态调整

识别精度:

- 加入机器学习模型(如基于 Haar 特征的手部检测器或深度学习模型)提升准确性。

界面增强:

- 添加更多交互按钮(如手动拍照、调整参数)。

- 支持实时调整窗口大小。

性能优化:

- 降低帧率或分辨率以减少 CPU 占用。

- 使用多线程分离视频处理和界面更新。

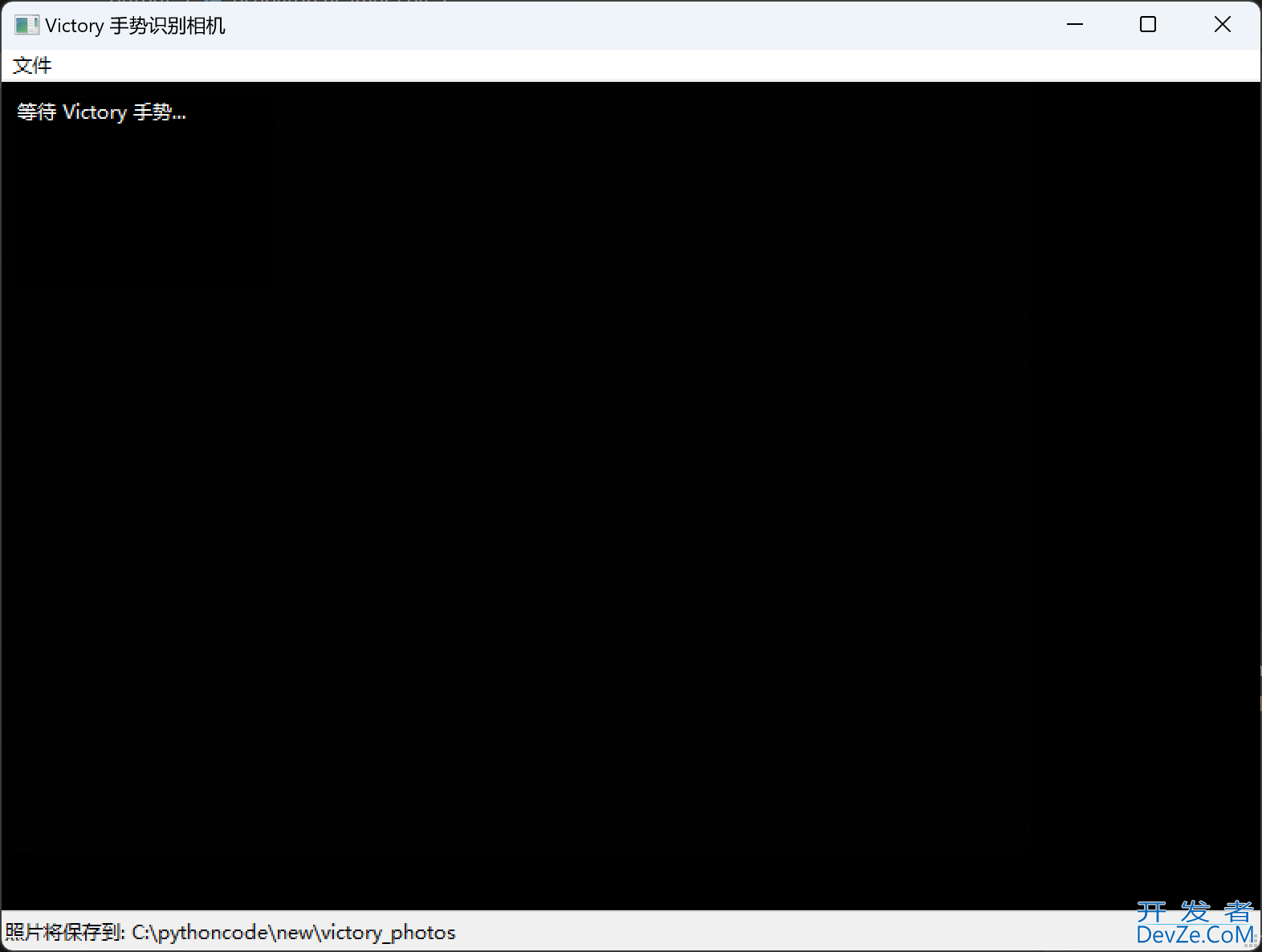

运行结果

总结

这个项目展示了如何结合 wxPython 和 OpenCV 实现一个功能丰富的手势识别相机。通过简单的肤色检测和轮廓分析,我们可以识别 Victory 和拳头手势,并控制拍照过程。虽然当前实现依赖于基本计算机视觉技术,但它为更复杂的模型集成提供了良好的基础。

以上就是使用wxPython和OpenCV实现手势识别相机功能的详细内容,更多关于wxPython OpenCV手势识别相机的资料请关注编程客栈(www.devze.com)其它相关文章!

加载中,请稍侯......

加载中,请稍侯......

精彩评论