Redis数据导出之多文件输出与编码问题的完整解决方案

目录

- 引言

- 问题背景与场景分析

- 原始需求

- 遇到的问题

- 技术原理深度解析

- python Logging模块工作机制

- 字符编码问题根源

- 完整解决方案

- 1. 多文件输出解决方案

- 2. 编码问题解决方案

- 性能优化与最佳实践

- 1. 内存优化策略

- 2. 错误处理与重试机制

- 3. 并发导出优化

- 实战应用示例

- 配置文件管理

- 完整的命令行工具

- 总结与展望

- 最佳实践要点

- 扩展思考

引言

在日常开发工作中,我们经常需要将Redis中的数据导出到文件进行后续分析或备份。Python作为数据处理的重要工具,结合Redis模块可以轻松实现这一功能。然而,在实际操作过程中,开发者往往会遇到两个常见问题:多文件输出混乱和字符编码错误。本文将详细分析这些问题产生的原因,并提供完整的解决方案。

问题背景与场景分析

原始需求

假设我们需要从Redis的多个哈希键中导出数据,每个键对应一个独立的日志文件。原始代码结构如下:

def export_redis_hash_to_log(redis_key, log_file_path):

# 配置日志

logging.basicConfig(filename=log_file_path, ...)

# 导出逻辑...

# 多次调用

export_redis_hash_to_log(key1, "file1.log")

export_redis_hash_to_log(key2, "file2.log")

遇到的问题

- 多文件输出问题:所有输出都写入到了第一个文件中

- 编码问题:遇到

UnicodeEncodeError: 'gbk' codec can't encode character错误

技术原理深度解析

Python Logging模块工作机制

Python的logging模块采用树形结构管理日志记录器。当我们使用basicConfig时,实际上是在配置根记录器(root logger)。重要的是:basicConfig只在第一次调用时生效,后续调用会被忽略。

import logging # 第一次调用 - 生效 logging.basicConfig(filename='file1.log') # 第二次调用 - 被忽略 logging.basicConfig(filename='file2.log') # 这个配置不会生效

这就是为什么所有日志都输出到第一个文件的原因。

字符编码问题根源

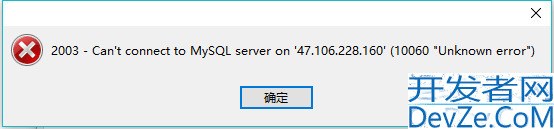

在Windows系统中,默认的字符编码是GBK,而Redis中的数据可能包含GBK无法表示的Unicode字符(如\u2f00)。当尝试将这些字符写入文件时,就会发生编码错误。

完整解决方案

1. 多文件输出解决方案

Python实现

import logging

from logging.handlers import RotatingFileHandler

def setup_logger(log_file_path, max_size_mb=10, backup_count=5):

"""

创建独立的日志记录器

参数:

log_file_path: 日志文件路径

max_size_mb: 单个文件最大大小(MB)

backup_count: 备份文件数量

"""

# 使用文件路径作为记录器名称,确保唯一性

logger = logging.getLogger(log_file_path)

# 避免重复添加处理器

if logger.handlers:

return logger

logger.setLevel(logging.INFO)

# 创建带轮转的文件处理器

max_bytes = max_size_mb * 1024 * 1024

file_handler = RotatingFileHandler(

log_file_path,

encoding='utf-8',

maxBytes=max_bytes,

backupCount=backup_count

)

# 设置日志格式

formatter = logging.Formatter(

'%(asctime)s - %(levelname)s - %(message)s',

datefmt='%Y-%m-%d %H:%M:%S'

)

file_handler.setFormatter(formatter)

logger.addHandler(file_handler)

logger.propagate = False # 防止向上传播到根记录器

return logger

Java对比实现

import org.apache.log4j.Logger;

import org.apache.log4j.RollingFilehttp://www.devze.comAppender;

import org.apache.log4j.PatternLayout;

import java.nio.charset.StandardCharsets;

public class RedisExporterLogger {

public static Logger setupLogger(String logFilePath, int maxFileSizeMB, int 编程客栈backupCount) {

// 获取或创建Logger实例

Logger logger = Logger.getLogger(logFilePath);

// 避免重复配置

if (logger.getAllAppenders().hasMoreElements()) {

return logger;

}

// 创建滚动文件Appender

RollingFileAppender appender = new RollingFileAppender();

appender.setFile(logFilePath);

appender.setEncoding(StandardCharsets.UTF_8.name());

appender.setMaxFileSize(maxFileSizeMB + "MB");

appender.setMaxBackupIndex(backupCount);

// 设置日志格式

PatternLayout layout = new PatternLayout();

layout.setConversionPattern("%d{yyyy-MM-dd HH:mm:ss} - %p - %m%n");

appender.setLayout(layout);

logger.addAppender(appender);

logger.setAdditivity(false); // 避免重复输出

return logger;

}

}

2. 编码问题解决方案

Python完整实现

def safe_string_processing(text):

"""

安全处理字符串,避免编码问题

参数:

text: 待处理的文本

返回:

处理后的安全文本

"""

if not isinstance(text, str):

text = str(text)

# 方法1: 替换无法编码的字符

cleaned_text = text.encode('utf-8', errors='replace').decode('utf-8')

# 方法2: 移除非ASCII字符(如果需要)

# cleaned_text = ''.join(char for char in text if ord(char) < 128)

# 清理换行符

cleaned_text = cleaned_text.replace('\n', ' ').replace('\r', '')

return cleaned_text

def export_redis_hash_to_log(redis_host, redis_port, redis_password,

redis_key, log_file_path, db=0):

"""

增强版的Redis哈希导出函数

"""

logger = setup_logger(log_file_path)

php

try:

# Redis连接配置

r = redis.Redis(

host=redis_host,

port=redis_port,

password=redis_password,

db=db,

decode_responses=True,

socket_connect_timeout=10,

socket_timeout=30, # 增加超时时间

retry_on_timeout=True # 超时重试

)

# 检查连接和键类型

if not check_redis_key(r, redis_key, logger):

return

# 批量获取数据(避免内存溢出)

export_hash_data(r, redis_key, logger)

except Exception as e:

handle_export_error(e, logger)

def check_redis_key(redis_conn, key, logger):

"""检查Redis键是否存在且为哈希类型"""

if not redis_conn.exists(key):

logger.warning(f"Key不存在: {key}")

return False

if redis_conn.type(key) != 'hash':

logger.warning(f"Key不是哈希类型: {key}")

return False

return True

def export_hash_data(redis_conn, key, logger, BATch_size=1000):

"""分批导出哈希数据"""

cursor = 0

total_count = 0

logger.info(f"开始导出哈希键: {key}")

while True:

cursor, data = redis_conn.hscan(key, cursor, count=batch_size)

if not data:

break

for field, value in data.items():

safe_field = safe_string_processing(field)

safe_value = safe_string_processing(value)

DjtqTncfB

logger.info(f"媒体请求: {safe_field}\n渠道响应: {safe_value}")

total_count += 1

if cursor == 0: # 迭代结束

break

logger.info(f"导出完成,总计{total_count}条记录")

Java完整实现

import redis.clients.jedis.Jedis;

import redis.clients.jedis.ScanParams;

import redis.clients.jedis.ScanResult;

import java.util.Map;

import java.nio.charset.StandardCharsets;

public class RedisHashExporter {

private static final Logger logger = Logger.getLogger(RedisHashExporter.class);

public void exportHashToFile(String host, int port, String password,

String redisKey, String filePath, int db) {

try (Jedis jedis = new Jedis(host, port)) {

// 认证

if (password != null && !password.isEmpty()) {

jedis.auth(password);

}

// 选择数据库

jedis.select(db);

// 检查键是否存在

if (!jedis.exists(redisKey)) {

logger.warn("Key does not exist: " + redisKey);

return;

}

// 检查键类型

if (!"hash".equals(jedis.type(redisKey))) {

logjavascriptger.warn("Key is not hash type: " + redisKey);

return;

}

// 分批扫描哈希

exportHashData(jedis, redisKey, filePath);

} catch (Exception e) {

logger.error("Export failed: " + e.getMessage(), e);

}

}

private void exportHashData(Jedis jedis, String key, String filePath) {

ScanParams scanParams = new ScanParams().count(1000);

String cursor = ScanParams.SCAN_POINTER_START;

int totalCount = 0;

do {

ScanResult<Map.Entry<String, String>> scanResult =

jedis.hscan(key, cursor, scanParams);

for (Map.Entry<String, String> entry : scanResult.getResult()) {

String safeField = safeString(entry.getKey());

String safeValue = safeString(entry.getValue());

String logMessage = String.format(

"媒体请求: %s\n渠道响应: %s", safeField, safeValue);

writeToFile(filePath, logMessage);

totalCount++;

}

cursor = scanResult.getCursor();

} while (!cursor.equals("0"));

logger.info("Export completed. Total records: " + totalCount);

}

private String safeString(String text) {

if (text == null) {

return "";

}

// 使用UTF-8编码处理

byte[] bytes = text.getBytes(StandardCharsets.UTF_8);

return new String(bytes, StandardCharsets.UTF_8)

.replace("\n", " ")

.replace("\r", "");

}

private synchronized void writeToFile(String filePath, String content) {

try (FileWriter writer = new FileWriter(filePath, StandardCharsets.UTF_8, true)) {

writer.write(content + "\n");

} catch (IOException e) {

logger.error("File write error: " + e.getMessage(), e);

}

}

}

性能优化与最佳实践

1. 内存优化策略

def memory_efficient_export(redis_conn, key, logger):

"""

内存友好的导出方式,使用HSCAN迭代

"""

cursor = '0'

total_processed = 0

while cursor != 0:

cursor, data = redis_conn.hscan(key, cursor=cursor, count=500)

for field, value in data.items():

# 处理并立即写入,不保存大量数据在内存中

process_and_log(field, value, logger)

total_processed += 1

# 每处理1000条记录提交一次

if total_processed % 1000 == 0:

logger.handlers[0].flush()

return total_processed

2. 错误处理与重试机制

import tenacity

@tenacity.retry(

stop=tenacity.stop_after_attempt(3),

wait=tenacity.wait_exponential(multiplier=1, min=4, max=10),

retry=tenacity.retry_if_exception_type((redis.ConnectionError, redis.TimeoutError))

)

def robust_redis_operation(redis_conn, operation, *args):

"""

带重试机制的Redis操作

"""

return operation(redis_conn, *args)

3. 并发导出优化

from concurrent.futures import ThreadPoolExecutor, as_completed

def concurrent_export(export_tasks, max_workers=3):

"""

并发执行多个导出任务

"""

with ThreadPoolExecutor(max_workers=max_workers) as executor:

future_to_task = {

executor.submit(

export_redis_hash_to_log,

task['host'], task['port'], task['password'],

task['key'], task['log_file'], task.get('db', 0)

): task for task in export_tasks

}

for future in as_completed(future_to_task):

task = future_to_task[future]

try:

future.result()

print(f"成功完成: {task['key']}")

except Exception as e:

print(f"任务失败 {task['key']}: {str(e)}")

实战应用示例

配置文件管理

import yaml

import json

def load_export_config(config_file):

"""

从配置文件加载导出任务

"""

if config_file.endswith('.yaml') or config_file.endswith('.yml'):

with open(config_file, 'r', encoding='utf-8') as f:

return yaml.safe_load(f)

elif config_file.endswith('.json'):

with open(config_file, 'r', encoding='utf-8') as f:

return json.load(f)

else:

raise ValueError("不支持的配置文件格式")

# config.yaml 示例

"""

redis:

host: "redis.example.com"

port: 6379

password: "your_password"

db: 1

export_tasks:

- key: "1188888:test:log2:1766666666-a3d555555555537"

log_file: "test_1766666666_a3d555555555537.log"

- key: "1188888:test:log2:1788888888-a3d555555555537"

log_file: "test_1788888888_a3d555555555537.log"

"""

完整的命令行工具

import argparse

import sys

def main():

parser = argparse.ArgumentParser(description='Redis哈希数据导出工具')

parser.add_argument('--config', required=True, help='配置文件路径')

parser.add_argument('--concurrent', type=int, default=1, help='并发任务数')

parser.add_argument('--verbose', action='store_true', help='详细输出模式')

args = parser.parse_args()

try:

config = load_export_config(args.config)

export_tasks = prepare_export_tasks(config)

if args.concurrent > 1:

concurrent_export(export_tasks, args.concurrent)

else:

for task in export_tasks:

export_redis_hash_to_log(**task)

print("所有导出任务完成")

except Exception as e:

print(f"程序执行失败: {str(e)}")

sys.exit(1)

if __name__ == "__main__":

main()

总结与展望

通过本文的详细分析,我们解决了Redis数据导出过程中的两个关键问题:

- 多文件输出问题:通过为每个日志文件创建独立的logger实例,避免了basicConfig的全局配置限制

- 编码问题:通过明确指定UTF-8编码和安全字符串处理,确保了各种字符的正确写入

最佳实践要点

- 使用独立的logger实例管理不同文件的输出

- 始终明确指定文件编码为UTF-8

- 实现安全字符串处理函数处理特殊字符

- 使用HSCAN进行分批处理避免内存溢出

- 添加适当的错误处理和重试机制

- 考虑并发处理提高导出效率

扩展思考

未来可以考虑的方向:

- 支持更多数据类型的导出(列表、集合、有序集合等)

- 添加数据转换和过滤功能

- 集成到数据流水线中实现自动化导出

- 添加监控和报警机制

通过本文提供的解决方案,你应该能够轻松处理Redis数据导出中的各种挑战,构建稳定可靠的数据导出系统。

以上就是Redis数据导出之多文件输出与编码问题的完整解决方案的详细内容,更多关于Redis数据导出的资料请关注编程客栈(www.devze.com)其它相关文章!

加载中,请稍侯......

加载中,请稍侯......

精彩评论